解决方案

为您提供量身定制的数字空间综合解决方案

行业类型

Meta推出AI新模型VFusion3D,可在几秒钟内从单个图像生成3D资产

日前,Meta和牛津大学的研究人员开发了一种新的3D生成式AI模型VFusion3D,能够从单张图像或文本描述生成高质量的3D对象,可能会改变虚拟现实、游戏和数字设计等领域。

VFusion3D界面简单直观,允许用户自己上传或从一系列预加载的示例中选择图像。预加载的示例表现非常出色,生成的3D模型和渲染视频以显著的准确性捕捉了原始2D图像的本质和细节。

据悉,研究团队利用预训练的视频人工智能模型生成合成3D数据,使他们能够训练更强大的3D生成系统,解决了长久以来的3D训练数据稀缺问题。

具体来看,这一过程本质上是教会模型从多个角度想象物体,研究人员对现有的视频人工智能模型进行了微调,以生成多视图视频序列,这些合成数据被用于训练VFusion3D。在测试中,与以前的最先进系统相比,该模型可以在几秒钟内从单个图像生成3D资产,人类评估者在90%以上的时间里更喜欢VFusion3D的3D建模。

随着更强大的视频AI生成模型的开发和更多3D数据可用于微调,研究人员预计VFusion3D的能力将迅速提高,这一突破最终可能会加速依赖3D内容的各个行业的创新。

游戏开发者可以快速制作角色和环境的原型,建筑师和产品设计师可以快速将概念以3D形式可视化,而VR/AR应用程序可能会因为AI生成的3D资产而变得更加身临其境。未来,个人和小团队也能够规模生产大型工作室级别的高质量3D模型。

目前,VFusion3D研究论文已被2024年欧洲计算机视觉会议(ECCV)接受,代码已在GitHub 上公开,允许其他研究人员在此基础上进行工作。随着这项技术的不断发展,VFusion3D有望重新定义3D内容创作的可能性边界,并开辟新的创意表达领域。

其他新闻

-

社交通讯平台 Telegram 发布 visionOS 版本演示:采用半透明界面

-

印度高等学院与MediSim VR合作建立VR实验室,以进行医学培训

-

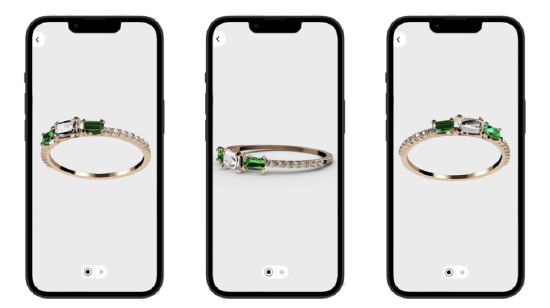

AR 公司 Wanna 推出 3D 查看器,以增强线上购物体验

联系电话

立即咨询

商务微信